バッチ正規化(Batch Normalization)は、深層学習モデルの最適化手法の一つであり、ニューラルネットワークの層ごとに入力データの正規化を行う手法です。バッチ正規化は、学習の安定性を向上させ、収束を加速させる効果があります。以下にバッチ正規化の要点を説明します。

バッチ正規化のアルゴリズムは、主に以下の手順で行われます:

ミニバッチ内の平均と分散の計算:

ミニバッチ(モデルに入力される一部のデータ)ごとに、各特徴の平均と分散を計算します。これにより、ミニバッチ内のデータの分布を把握します。

平均と分散の正規化:

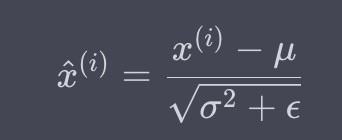

計算された平均と分散を使用して、ミニバッチ内のデータを正規化します。具体的には、各特徴に対して、以下の式に基づいて正規化を行います(\(\epsilon\)は数値安定性のための小さな値)

ここで、\(x^{(i)}\)は入力特徴、\(\mu\)は平均、\(\sigma^2\)は分散です。

スケールとシフトの適用:

正規化されたデータに対して、スケール(スケーリング係数)とシフト(シフト係数)を適用して、変換されたデータを得ます。これにより、モデルがデータの変換を学習することが可能になります。

学習可能なパラメータの導入:

スケールとシフトのパラメータは、学習可能なパラメータとしてモデルに導入されます。これにより、ネットワーク自体がデータの正規化と変換を最適な形で学習することができます。

バッチ正規化は、勾配の消失や爆発の問題を軽減し、学習の安定性を向上させる効果があります。また、学習率の選択に対する感度を減少させ、モデルの収束を加速させる効果もあります。バッチ正規化は一般的に、畳み込みニューラルネットワークや全結合層を持つモデルで使用されることが多いです。